اخبار:

ارائه الگوریتم جدیدی برای یادگیری عمیق توسط جفری هینتون

جفری هینتون، استاد دانشگاه تورنتو و پژوهشگر Google Brain، اخیرا مقاله ای با نام الگوریتم Forward-Forward منتشر کرده است، تکنیکی برای آموزش شبکه های عصبی که به جای الگوریتم پس-انتشار (backpropagation) از دو گذر داده به جلو از طریق شبکه، برای به روز رسانی وزن مدل استفاده می کند. انگیزه هینتون برای این الگوریتم پرداختن به برخی از کاستی های آموزش پس-انتشار استاندارد است که به دانش کامل محاسبات در گذر رو به جلو برای محاسبه مشتقات و ذخیره مقادیر فعال ساز در طول آموزش نیاز دارد. هینتون نشان داد که شبکه های آموزش دیده با الگوریتم FF می توانند وظایف بینایی کامپیوتر را در حد شبکه هایی که با استفاده از الگوریتم پس-انتشار آموزش دیده اند انجام دهند.

صنعت:

هوش مصنوعی سونی ماشین های مسابقه ای را مانند یک قهرمان، رانندگی می کند

بازیهای ویدیویی در سال های اخیر به یک زمینه مهم برای تحقیقات هوش مصنوعی تبدیل شدهاند، اما بازی Gran Turismo یک چالش جدید و مهم برای هوش مصنوعی بوده است. میازونو قهرمان جهانی این بازی، تا به حال هرگز با راننده گرن توریسمویی مانند GT Sophy روبرو نشده است، یک هوش مصنوعی که توسط سونی و Polyphony Digital ساخته شده است. سوفی بسیار سریع است و عکس العمل های آن بهتر از حد انتظار است. تکنیک های مورد استفاده برای توسعه GT Sophy می تواند به توسعه اتومبیل های خودران کمک کند.

مقاله:

Designing BERT for Convolutional Networks: Sparse and Hierarchical Masked Modeling

در این مقاله، نویسندگان دو مانع کلیدی را در گسترش موفقیت پیش آموزشی (pre-training) به سبک BERT، یا مدلسازی تصویر ماسکدار، به شبکههای کانولوشنال (convnets) شناسایی و بر آن غلبه کردند: (1) عملیات کانولوشن نمیتواند تصاویر ورودی نامنظم و با پوشش تصادفی را مدیریت کند. (2) ماهیت تک مقیاسی پیش آموزشی BERT با ساختار سلسله مراتبی convnet ناسازگار است. برای (1)، آنها پیکسلهای بدون ماسک را بهعنوان وکسلهای پراکنده ابرهای نقطه سهبعدی در نظر میگیرند و از کانولوشن پراکنده برای رمزگذاری استفاده میکنند. این اولین استفاده از کانولوشن پراکنده برای مدل سازی ماسک دو بعدی است. برای (2)، آنها یک رمزگشای سلسله مراتبی برای بازسازی تصاویر از ویژگی های کدگذاری شده چند مقیاسی توسعه می دهند. این روش کهSparse masked modeling (SparK) نامیده میشود، کلی است: میتوان آن را مستقیماً روی هر مدل کانولوشنی بدون تغییرات ستون فقرات استفاده کرد. آنها آن را در هر دو مدل کلاسیک (ResNet) و ( ConvNeXt) تأیید میکنند: در سه کار رو به پایین، از هر دو روش یادگیری متضاد پیشرفته و مدلسازی ماسکدار مبتنی بر ترنسفورمر با حاشیههای مشابهی پیشی میگیرد. پیشرفتها در تشخیص شی و تقسیمبندی نمونهها اساسیتر هستند و قابلیت انتقال قوی ویژگیهای آموخته شده را تأیید میکنند. آنها همچنین رفتار مقیاس پذیری مطلوب آن را با مشاهده دستاوردهای بیشتر در مدل های بزرگتر پیدا می کنند. همه این شواهد آینده امیدوارکنندهای را برای پیشآموزش مولد در شبکههای convnets نشان میدهند.

آموزش:

معیارهای ارزیابی چیست؟

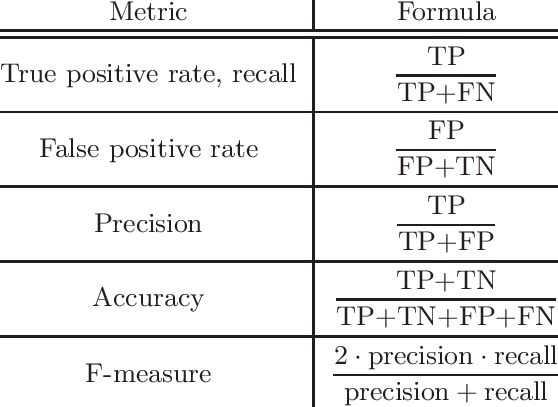

معیارهای ارزیابی برای اندازه گیری کیفیت مدل آماری یا یادگیری ماشین استفاده می شوند. ارزیابی مدل ها یا الگوریتم های یادگیری ماشین برای هر پروژه ای ضروری است. انواع مختلفی از معیارهای ارزیابی برای آزمایش یک مدل وجود دارد. از جمله این موارد می توان به دقت طبقه بندی، خطای لگاریتمی، ماتریس سردرگمی و موارد دیگر اشاره کرد. دقت طبقهبندی نسبت تعداد پیشبینیهای صحیح به تعداد کل نمونههای ورودی است که معمولاً هنگام استفاده، از اصطلاح دقت به آن اشاره میکنیم. خطای لگاریتمی، با جریمه کردن طبقه بندی های نادرست عمل می کند. یک ماتریس سردرگمی یک ماتریس به عنوان خروجی به ما می دهد و عملکرد کامل مدل را توصیف می کند. معیارهای ارزیابی دیگری نیز وجود دارد که می توان از آنها استفاده کرد. معیارهای ارزیابی شامل استفاده از ترکیبی از این معیارهای ارزیابی برای آزمایش یک مدل یا الگوریتم است.

چرا این معیارها مفید است؟

استفاده از معیارهای ارزیابی چندگانه برای ارزیابی مدل خود بسیار مهم است. این به این دلیل است که یک مدل ممکن است با استفاده از یک اندازه گیری از یک معیار ارزیابی عملکرد خوبی داشته باشد، اما ممکن است با استفاده از اندازه گیری دیگر از یک معیار ارزیابی دیگر عملکرد ضعیفی داشته باشد. استفاده از معیارهای ارزیابی برای اطمینان از اینکه مدل شما به درستی و بهینه عمل می کند بسیار مهم است.

کاربردهای معیارهای ارزیابی:

تحلیل آماری

یادگیری ماشین

کدینگ:

پایتون دکوراتور

در پایتون، دکوراتور یک الگوی طراحی است که به شما امکان می دهد عملکرد یک تابع را با قرار دادن آن در یک تابع دیگر تغییر دهید. تابع خارجی Decorator نامیده می شود که تابع اصلی را به عنوان آرگومان می گیرد و نسخه اصلاح شده آن را برمی گرداند. پس، دکوراتور تابعی است که تابعی دیگری را می گیرد و رفتار تابع دوم را بدون تغییر صریح آن گسترش می دهد.

راه های ارتباطی با ما:

اینستاگرام:

princeofai@

وبسایت:

https://hushmandkharazmi.com